Ceph vs Storage Spaces Direct MS S2D

Published on November 5, 2025

หากพูดถึง Software Defined Storage (SDS) นั้นต้องเรียกว่า มันกำลังได้รับความนิยมมากขึ้นเรื่อยๆ เพราะมันขับเคลื่อนด้วยความต้องการที่จะเปลี่ยนทุกอย่างให้สามารถควบคุมด้วยซอฟต์แวร์ได้ ในตลาดนั้นต้องบอกว่า มีหลายผู้ผลิตที่ทั้งอยู่ในตลาดเดิม และ กำลังเข้ามาแข่งขัน แต่หากจะพูดถึง โปรดักส์ที่เป็นที่นิยมมาก และ มีการใช้งานมานานนั้น เราก็คงจะคุ้นเคยกับ Ceph และ Microsoft Storage Spaces Direct (S2D) และ ในวันนี้เราจะพาไปพบกับการเปรียบเทียบคุณสมบัติของทั้งคู่ในแง่มุมที่น่าสนใจ

Storage Spaces Direct (S2D)

สำหรับ S2D นั้นสามารถที่จะจัดการรวม Internal Storage ในแต่ละโหนดไม่ว่าจะเป็น NVMe, SSD, HDD เข้ามาเป็น pool กลาง และ ถูกจัดการแบบดิสก์เสมือน และ มันก็จะถูกแชร์ไปยังโหนดต่างๆ ในคลัสเตอร์ เป็น Cluster Shared Volumes (CSV) ตัวมันสามารถทำหน้าที่เป็นแคชในตัว โดยอาจจะจับ NVMe มาทำเป็นแคชได้

Ceph

Ceph นั้นเป็น open-source software defined storage solution ที่มีการใช้งานมานานในหมู่ผู้ใช้ opensource และ cloud provider ทั่วโลก มีความเสถียรสูง และ มีหลักการทำงานไม่ต่างจาก S2D เพราะมันรวมดิสก์ในแต่ละโหนด เข้ามาเป็นดิสก์เสมือนและ แชร์ storage pool ไปยังแต่ละโหนด

การเปรียบเทียบโดยภาพรวม

| Ceph | S2D | |

| ระบบ | Opensource SDS | Microsoft SDS |

| การทำงาน | object/block/file | block/file |

| เหมาะกับ | Cloud,Virtualzation, Container และ KVM Based | Hyper-V, Windows only |

ฟีเจอร์หลัก

| ข้อเปรียบเทียบ | Ceph | S2D |

|---|---|---|

| การจัดการข้อมูล (Data Management) | ใช้อัลกอริทึม CRUSH ในการกระจายข้อมูลอัตโนมัติ (ไม่ต้องมี metadata server สำหรับ block/object) | ใช้ cluster volume layout ของ Windows Server (CSV + Storage Pool) |

| Replication / Fault Tolerance | มีทั้ง replication และ erasure coding ให้เลือก | มี mirror, mirror-accelerated parity, dual parity (คล้าย RAID) |

| การเข้าถึงข้อมูล | รองรับ RADOS Block (RBD), CephFS (POSIX), S3-compatible object storage | รองรับ SMB3, iSCSI, CSVFS, และ ReFS |

| Scalability (การขยายระบบ) | Scale-out ได้เกือบไม่จำกัด (เพิ่ม node ได้เรื่อย ๆ) | จำกัดอยู่ที่ 16 node ต่อ cluster |

| Performance | ดีมากในระบบขนาดใหญ่ โดยเฉพาะเมื่อใช้ SSD/NVMe และมีการกำหนด class | ดีในระบบ Hyper-V (ใช้ SMB Direct + RDMA ได้) |

| Self-healing / Rebalance | มีการซ่อมแซมอัตโนมัติเมื่อ disk/node ล่ม | มี automatic repair แต่ไม่ยืดหยุ่นเท่า Ceph |

| Monitoring / Management | ใช้ Dashboard Ceph Dashboard, Prometheus, Grafana หรือ customize เองได้ | ใช้ Windows Admin Center, PowerShell |

| Automation / Integration | ใช้งานกับ Kubernetes, OpenStack, Proxmox ได้โดยตรง | ใช้กับ Hyper-V, SCVMM, Azure Stack HCI |

| Protocol Support | Block / Object / File | Block / File เท่านั้น |

| Licensing / Cost | Open Source (ฟรี) หรือ Enterprise Support จาก Red Hat, SUSE | ต้องใช้ Windows Server Datacenter license (มีค่าใช้จ่ายสูง) |

| Hardware Flexibility | ใช้กับฮาร์ดแวร์ทั่วไปได้เกือบทั้งหมด | ควรใช้ฮาร์ดแวร์ที่ผ่านการรับรอง “Windows Certified Hardware” |

เรามาดูในเรื่องของข้อจำกัดกันบ้าง Limitations

| หมวด | Ceph | S2D |

|---|---|---|

| ความซับซ้อนในการติดตั้ง | อาจจะต้องใช้ผู้ที่คุ้นเคยกับ Linux อยู่บ้าง ยกเว้นท่านใช้ GUI ของ บางค่ายเช่น Proxmox VE (MON, OSD, MGR, MDS) | ติดตั้งง่ายกว่า (Wizard / GUI พร้อมใน Windows Admin Center) |

| การดูแลรักษา | ใช้เครื่องมือ monitoring แยก (Prometheus, Grafana) | มี GUI จัดการง่าย แต่ปรับแต่งได้จำกัด |

| Compatibility | การ integrate กับ Windows/SMB ผ่าน gateway แต่ถ้าเป็น Proxmox VE สามารถทำได้เลย | รองรับเฉพาะ ecosystem ของ Microsoft เท่านั้น |

| Performance tuning | ต้องจูนเอง (network, OSD, journaling) เพราะมีเงื่อนไขเยอะ ด้วยความยืดหยุ่นของมันเอง | มี performance ดีโดย default |

| การรองรับ OS/Hypervisor | รองรับหลายแพลตฟอร์ม | Hyper-V เท่านั้น |

| ค่าใช้จ่ายแฝง | ต้องดูแลระบบเอง หรือจากบาง vendors | ต้องมี license Windows Server Datacenter ซึ่งแพงมาก |

| Cluster Size Limit | รองรับ cluster ขนาดใหญ่หลายร้อย node | จำกัดจำนวน node default 16 |

| การอัปเกรดระบบ (Rolling Upgrade) | รองรับแบบ rolling upgrade (no downtime) | รองรับบางส่วน แต่ต้อง reboot node |

ด้วยการเปรียบเทียบดังกล่าว ท่านคงจะได้เห็นข้อจำกัด สำหรับแต่ละ SDS เพื่อประโยชน์ของการตัดสินใจบางแล้ว หากท่านมีคำถามสามารถ ติดต่อเราได้ที่ Line OA : @avesta.co.th หรืออีเมล์ [email protected]

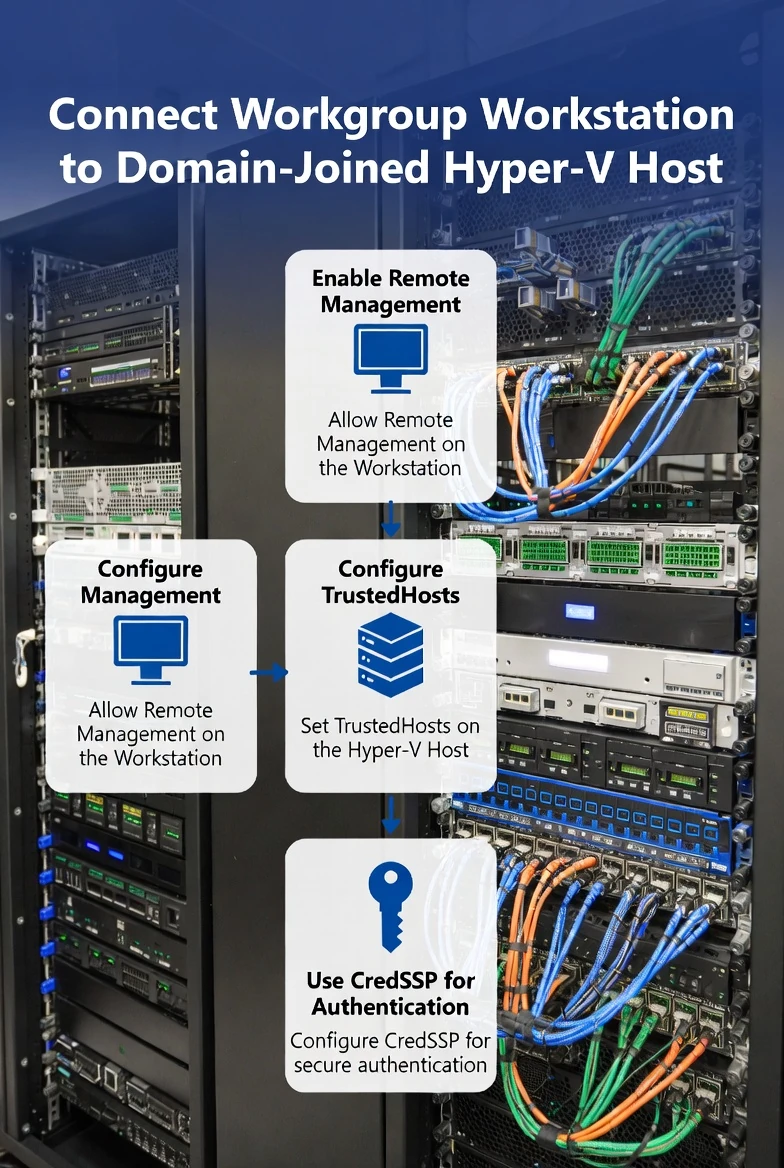

การเชื่อมต่อไปยัง Hyper-V จาก Workstation ที่มีสถานะของโดเมนต่างกัน

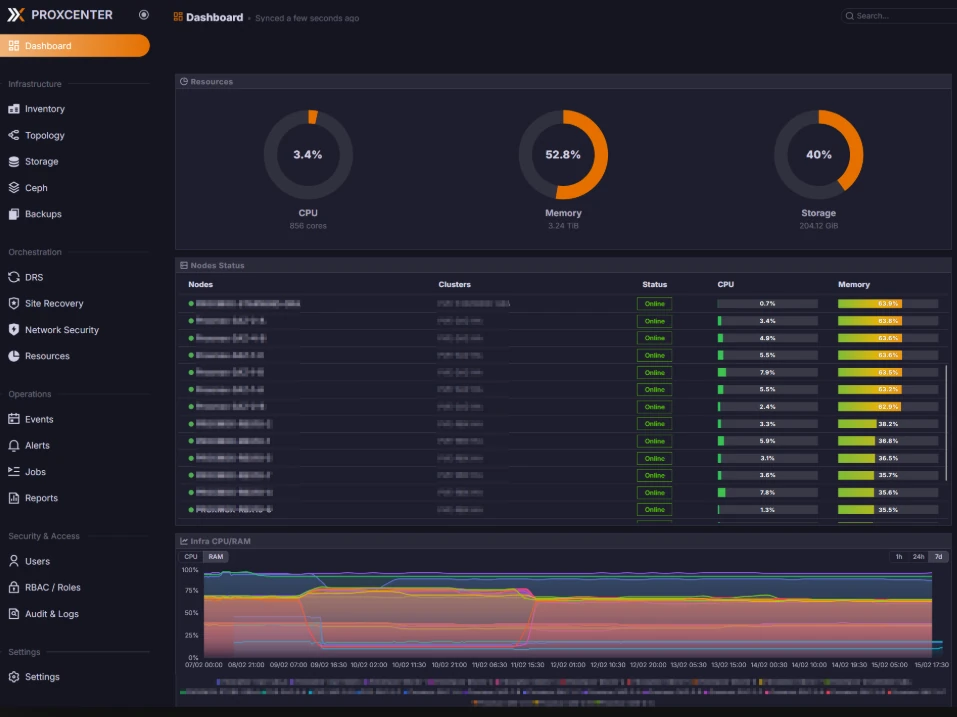

วิธีติดตั้งและตั้งค่า ProxCenter เชื่อมต่อ Proxmox VE ใช้งานจริง

ขับเคลื่อนความยั่งยื่นด้าน IT ผ่านกลยุทธ์ RSE

ProxCenter บริหาร Proxmox VE แบบเดียวกับ vCenter ใน VMware

ทดสอบการรับภาระงานและความเค้นใน Web App และ API ด้วย Gatling